ABD ordusunun Nicolás Maduro’yu kaçırma operasyonunda Claude’u kullandığının ortaya çıkmasıyla gözler önüne serilen Anthropic-Pentagon geriliminde ipler kopma noktasına geldi. Pentagon, Anthropic’le olan iş birliğini sonlandırdığını ve şirketi kara listeye aldığını duyurdu. Krizin merkezinde, Pentagon’un yapay zekâ modellerindeki güvenlik önlemlerinin kaldırılması ve modellerin “tüm yasal amaçlar” için serbestçe kullanılabilir hâle getirilmesi talebi yer alıyordu. Anthropic ise kırmızı çizgisi olarak ifade ettiği iki konuda taviz vermeyeceğini ifade etti:

- Modellerinin Amerikan vatandaşlarının gözetlenmesinde kullanılmaması

- Modellerinin otonom silah sistemlerinde yer almaması

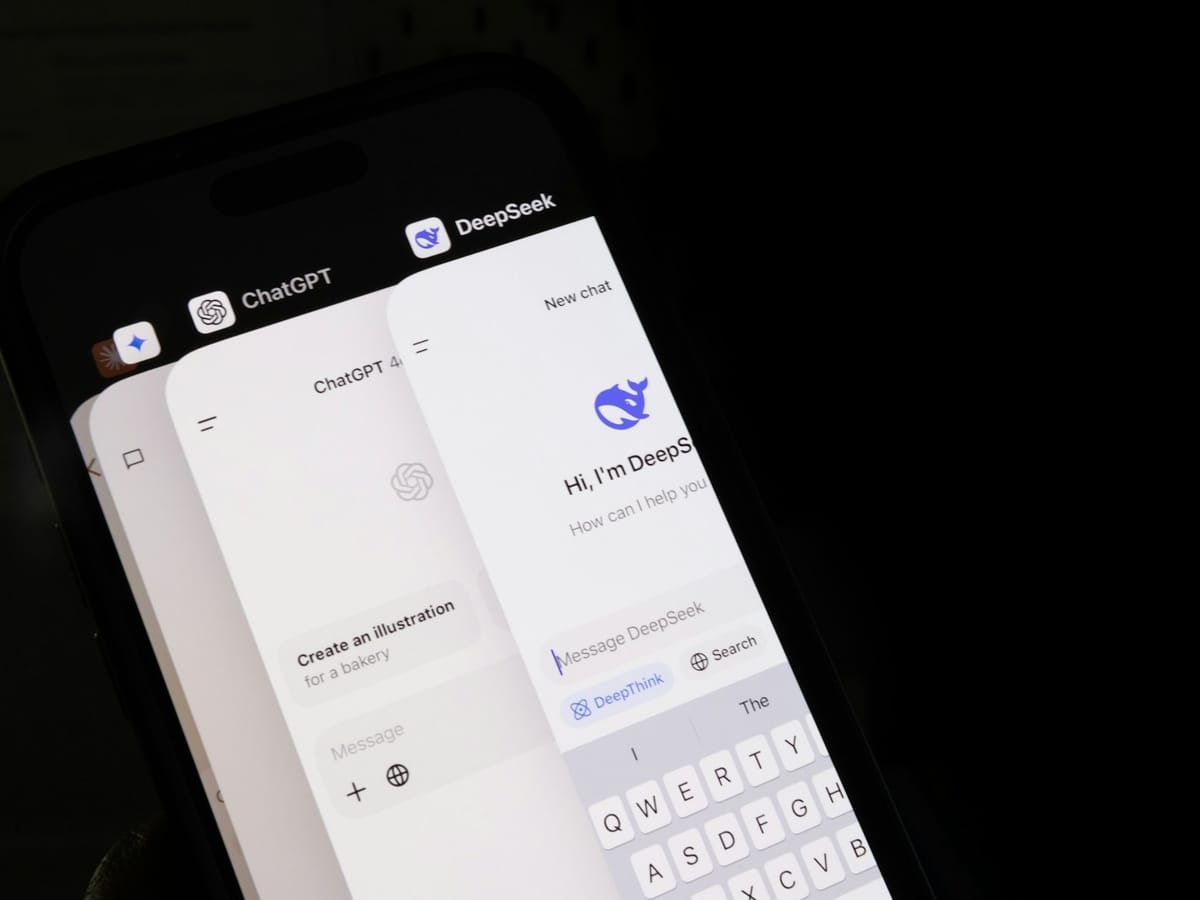

Bu anlaşmazlığı fırsat bilen OpenAI, kontrat feshi haberinden yalnızca birkaç saat sonra Pentagon ile gizli askerî sistemlere yapay zekâ altyapısı sağlamak üzere anlaşmaya vardı. CEO Sam Altman, Anthropic’in kırmızı çizgilerini paylaştıklarını ve Pentagon’un bu şartları kabul ettiğini iddia etse de kamuoyundaki genel kanı OpenAI’ın Pentagon’un taleplerine boyun eğdiği yönünde. Sosyal medyada büyük tepki toplayan bu anlaşma, kullanıcıların ChatGPT üyeliklerini iptal edip başta Claude olmak üzere farklı alternatiflere geçmeye başladıkları #QuitGPT akımının fitilini ateşledi.

Anthropic çok mu ahlaklı?

Sosyal medyada #QuitGPT hareketi çığ gibi büyüse de mecrada tartışma konusu yaratan bir soru, piyasada gerçekten etik bir alternatifin olup olmaması üzerine. Bu tartışmanın merkezinde #QuitGPT hareketinin en büyük kazananı gibi görünen Anthropic yer alıyor. Çünkü Anthropic, her ne kadar Pentagon’la yaşadığı anlaşmazlıktan sonra “insanî değerlerin savunucusu” gömleğini üstüne geçirmiş olsa da, 2024’ten beri Palantir’in arayüzü aracılığıyla Amerikan askerî sistemlerine yapay zekâ desteği sağlıyor.

Washington Post’un haberine göre Claude, ABD’nin İran operasyonunda da aktif olarak hedef belirleme, hedefin konum bilgisini hesaplama ve hedefleri öncelik sırasına sokma gibi kritik görevlerde kullanılıyor. Üstüne üstlük, “insan odaklı, güvenilir yapay zekâ” mottosuyla kurulan Anthropic, 2023 yılında kuruluş değerlerini pratiğe geçirebilmek maksadıyla hazırladığı “Sorumlu Ölçeklendirme Politikası”nda (Responsible Scaling Policy) geçtiğimiz ay dramatik bir sadeleştirmeye gitti. Bu sadeleştirme kapsamında şirket, temel prensiplerinden biri olarak gösterdiği “güvenlik önlemlerinin yetersiz kalması durumunda yapay zekâ sistemlerini geliştirmeyi durdurma” maddesini sessiz sedasız sildi. Şirketin beş yılda kaydettiği tarihî büyüme ve buna paralel olarak esneyen politikaları, Batılı girişimcilik dünyasındaki “iyilik için teknoloji” akımının marketteki talebe yönelik bir konumlandırmadan öteye gidemediğini gösterir nitelikte.

Peki vatandaş ne yapsın?

Tüm bu olanların ışığında, verilecek ideal tepki büyük teknoloji şirketlerine ait olan veya bu şirketlerin kontrolündeki altyapılara bağımlı olan tüm yapay zekâ ürünlerinin boykot edileceği bir #QuitAI hareketi olabilirdi. Ancak çoğumuzun içerisinde bulunduğu materyal koşullar, bu şirketleri tek seferde hayatımızdan koparıp atmamıza izin vermiyor. Tarihçi Rutger Bregman, tüketici temelli bir boykotun etkili olabilmesi için iki tane ön koşul sunuyor: boykotun sınırlı bir alanda yapılması ve kolayca uygulanabilir olması. Tüm yapay zekâ sektörünü boykot etmektense kolayca erişilebilir alternatifleri bulunan OpenAI modellerini boykot etmek, bu iki ön koşulu da sağlıyor, böylelikle kitlelerin eyleme geçmesi kolaylaşıyor. Bu bağlamda daha gerçekçi bir alternatif, ABD’ye kıyasla regülasyona daha çok önem veren AB ekosisteminden çıkmış modelleri değerlendirmek olabilir. Örneğin Le Chat ve Lumo AI, Avrupa menşeili güçlü modeller olarak ön plana çıkıyor.

Bu tarz boykotlarda dikkate alınması gereken bir diğer husus, eyleme katılan kişilerin “tüketici” kimliğinin ön plana çıkması sonucu boykotun, tıpkı diğer tüketim trendlerinde olduğu gibi, bir saman alevi edasıyla sönmesi riski. Söz konusu riski azaltmanın yolu ise boykotu bireysel bir “abonelik iptalinin” ötesine taşıyıp kolektif bir harekete dönüştürmekten geçiyor. Bireyselliği temel alacak şekilde kodlanmış toplumumuzda kolektif bilinç kasının gelişmesi, bireylerin gündelik hayatlarının işleyişinde daha çok söz sahibi olmalarına ve farklı etkili stratejiler geliştirmelerine yol açacaktır. Bu perspektiften bakınca boykot, büyük teknoloji şirketlerinin bilançolarında ciddi maddî yaralar açmasa bile insanları diyalog kurmaya, teknoloji devlerine karşı duruş göstermeye, ve kolektif hareket etmeye teşvik ettiği ölçüde başarılı olur diyebiliriz.